Los candidatos no fueron los únicos protagonistas de las elecciones legislativas del pasado domingo en la Ciudad. Durante la noche del sábado, horas antes de los comicios, un falso Mauricio Macri “anunció” en un video generado por Inteligencia Artificial (IA) que “bajaba” la candidatura de su principal postulante, Silvia Lospennato, instando a sus votantes a optar por Manuel Adorni, de La Libertad Avanza.

“Se avecina un tsunami de este tipo de contenido”, advirtió Santiago Siri durante una conversación con el equipo de periodistas del programa “QR”. El especialista en IA subrayó la necesidad de comprender que la desinformación, en sus diversas formas, ha llegado para quedarse.

El video falso en cuestión es técnicamente conocido como deepfake, que consiste en audios o videos manipulados mediante inteligencia artificial, alterando la apariencia o la voz de una persona para hacer creer que dice o hace algo que no ocurrió.

Siri explicó en el programa, que se transmite por Bravo TV de lunes a viernes a las 22, que rastreó la cuenta de origen del video y aquellas que luego amplificaron esta pieza desinformante. El primero en tuitear el contenido en la red social X, según Siri, fue un usuario llamado Tendencias (@TTendenciaX). Entre sus seguidores se encuentra nada menos que Karina Milei, hermana y secretaria general de la Presidencia, quien sigue a solo 145 tuiteros, lo que llevó al especialista a concluir que podría haber una relación cercana entre ambos.

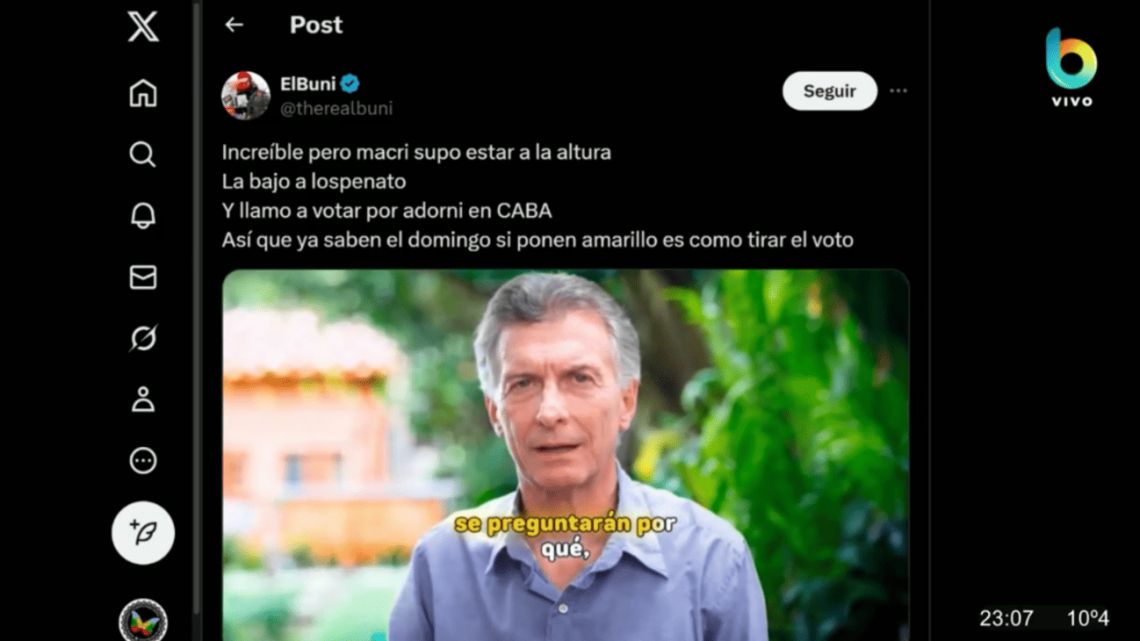

Una vez publicado, el deepfake fue amplificado por un grupo de usuarios vinculados al entorno comunicacional del presidente Javier Milei: ElBuni (@therealbuni), El Trumpista (@ElTrumpista), Gordo Dan (@GordoDan_), cuyo nombre real es Daniel Parisini, y Giovanni (@giovannilarosa0), además de cuentas atribuidas al asesor presidencial, Santiago Caputo.

“Se difundió desde cuentas paraoficiales y coordinadas al estilo $LIBRA”, señaló Siri. Todos los usuarios mencionados por el especialista son conocidos por difundir desinformación diariamente en redes sociales.

El PRO ha presentado una denuncia judicial. Siri aclaró que existen leyes que permiten tomar acciones contra quienes difaman o suplantan identidades, aunque el Congreso podría legislar específicamente sobre este tema.

“El video, sea cierto o no, mostró a un Mauricio Macri a la defensiva”, comentó Pablo Caruso, periodista y conductor del programa, refiriéndose a que el expresidente se vio obligado a negar públicamente el contenido. El PRO también emitió rápidamente un comunicado para desmentir el video, pero el impacto en la opinión pública es difícil de cuantificar.

El especialista relató que este tipo de material sintético es sencillo de crear; “un chico puede hacerlo en 20 minutos sentado en el baño”, subrayó, destacando que las herramientas necesarias están disponibles para cualquiera en Internet. También advirtió que las personas mayores son más susceptibles a creer en estos engaños, aunque nadie está exento, especialmente considerando que la verosimilitud de estas piezas sigue aumentando.

Los deepfakes, en ocasiones, incluyen voces reales que han sido clonadas, lo que puede llevar a cualquier persona involucrada en una controversia a calificar un audio auténtico como sintético, generando dudas. Un caso notable fue el del presidente de la Cámara de Diputados, Martín Menem, quien en marzo descalificó un audio filtrado que contenía su voz, argumentando que era “falso”. Este ejemplo ilustra que, en la actual era digital, lo que es falso puede parecer verdadero, y viceversa.

FPT